Коли Сем Альтман, генеральний директор OpenAI, зайшов минулої середи вранці до бюро The Times у Сан-Франциско, він виглядав безтурботним і розслабленим - щасливий магнат у помаранчевому балахоні, який їде на хвилі успіху на вершині однієї з найгарячіших компаній Кремнієвої долини.

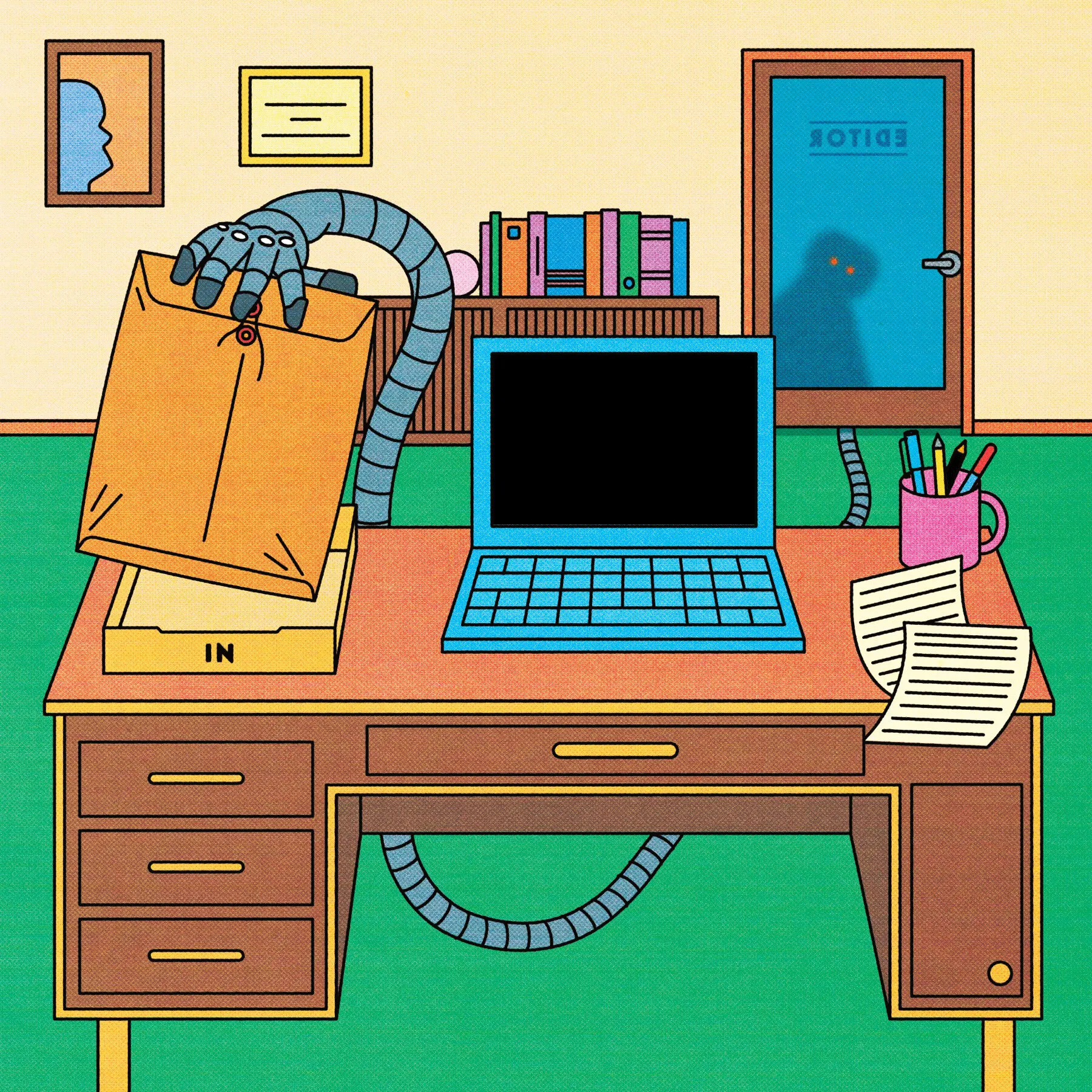

Пан Альтман був там, щоб записати інтерв'ю для подкасту "Hard Fork", який я веду разом з ним, і обговорити рік, який він пережив з моменту випуску ChatGPT, чат-бота, що підкорив світ і дав старт буму штучного інтелекту.

Ніхто з нас, включно з паном Альтманом, і гадки не мав, що через два дні його звільнять з OpenAI за рішенням ради директорів компанії, або що його звільнення стане початком однієї з найдраматичніших подій в новітній історії Кремнієвої долини.

Менш ніж через тиждень після нашого інтерв'ю для пана Альтмана все змінилося. Тепер він планує очолити нову передову лабораторію штучного інтелекту в Microsoft разом зі своїм співзасновником Грегом Брокманом, який покинув OpenAI на знак солідарності. Майже всі співробітники OpenAI пригрозили, що перейдуть до Microsoft, якщо рада директорів не поновить панів Альтмана і Брокмана.

У нашому інтерв'ю пан Альтман розповів про успіх ChatGPT, свій оптимізм щодо майбутнього ШІ та про те, чи є він "акселератором", який вважає, що ШІ повинен розвиватися швидше.

Ми досі не знаємо точної причини звільнення пана Альтмана, але Ілля Суцкевер, головний науковий співробітник OpenAI і член правління, який очолив переворот, як повідомляється, був незадоволений агресивним прагненням пана Альтмана до прискорення розвитку ШІ. І хоча пан Альтман більше не очолює OpenAI, він все ще залишається найбільшою фігурою в галузі ШІ, а його погляди залишаються актуальними, як ніколи.

Це відредагована стенограма розмови між мною, моїм співведучим Кейсі Ньютоном та паном Альтманом.

Кейсі Ньютон: Минув лише рік з моменту виходу ChatGPT, і мені цікаво, чи не думали ви про те, куди він привів нас у розвитку штучного інтелекту?

Сем Альтман: Чесно кажучи, це був дуже напружений рік. Не було часу на роздуми.

Кейсі Ньютон: Саме тому ми запросили вас. Ми хочемо, щоб ви поміркували тут.

Сем Альтман: Чудово. Я можу зробити це зараз. Я вважаю, що це був рік, коли середньостатистичний технічний працівник перейшов від несерйозного ставлення до штучного інтелекту до досить серйозного. З огляду на це, я думаю, що в певному сенсі це найбільш значуще оновлення року.

Кейсі Ньютон: Гадаю, що більшу частину минулого року ви спостерігали за тим, як світ наздоганяє речі, про які ви думали протягом певного часу. Чи відчуваєте ви це?

Сем Альтман: Так, це так. Усередині OpenAI ми завжди думали, що дивно, що решта світу не ставиться до цього більш серйозно, що він не захоплений цим.

Кейсі Ньютон: Думаю, якби це було п'ять років тому, і ви пояснили, що таке ChatGPT, я б подумав: "Ого, звучить досить круто". Але, гадаю, доки я не почала ним користуватися, мені було важко зрозуміти, що це таке.

Сем Альтман: Насправді я думаю, що ми могли б пояснити це, і це не мало б великого значення. Ми намагалися. Люди зайняті своїм життям.

Кевін Руз: Тож мені цікаво, що, на вашу думку, ви дізналися про мовні моделі саме з того, що випустили їх у світ.

Сем Альтман: Я вважаю, що в лабораторії неможливо зрозуміти, як будуть еволюціонувати технології та суспільство. Тобто, ви можете сказати: "Ось що модель може робити або не робити". Але ви не можете сказати: "А ось як саме суспільство буде розвиватися разом з нею". І тут треба просто подивитися, що люди роблять, як вони це використовують.

Один з прикладів, який я вважаю повчальним, тому що він був першим і найгучнішим, - це те, що сталося з ChatGPT і освітою. Через кілька днів після виходу ChatGPT шкільні округи почали з усіх сил намагатися заборонити його. І це нас не дуже здивувало. Ми могли це передбачити. Але те, що сталося після цього - дуже швидко - це те, що шкільні округи та вчителі сказали: "Ей, насправді, ми зробили помилку. І це дійсно важлива частина майбутнього освіти. І переваги набагато переважають недоліки. І ми не тільки не забороняємо, але й заохочуємо наших вчителів використовувати його в класі. Ми заохочуємо наших студентів добре опанувати цей інструмент, тому що він стане частиною способу життя людей".

І це просто не те, що могло б статися, якби ми не випустили його.

Кевін Руз: Озираючись назад, чи не хотіли б ви зробити більше для того, щоб дати людям якусь інструкцію: "Ось як ви можете використовувати це в школі чи на роботі"?

Сем Альтман: Дві речі. По-перше, я хотів би, щоб ми зробили щось проміжне між випуском GPT-3.5 в API і ChatGPT. Я не знаю, наскільки добре це спрацювало б, тому що я думаю, що був би якийсь момент, коли це стало б вірусним.

Друге питання - чи варто було випускати більше посібників? Чесно кажучи, я не знаю. Я думаю, що ми могли б зробити деякі речі, які були б корисними, але я дійсно вважаю, що для технологічних компаній не є оптимальним говорити людям: "Ось як використовувати цю технологію" і "Ось як робити те чи інше". І органічна річ, яка там сталася, насправді була досить хорошою.

Кевін Руз: Я хочу поговорити про AGI та шлях до AGI пізніше. Але спочатку я хочу дати визначення AGI.

Сем Альтман: Я вважаю, що це смішний і безглуздий термін.

Кевін Руз: Так?

Сем Альтман: Тому я перепрошую, що продовжую його використовувати.

Кевін Руз: Я маю на увазі, що я просто ніколи не знаю, про що люди говорять, коли вони говорять про це.

Сем Альтман: Вони мають на увазі дійсно розумний ШІ.

Кевін Руз: Так. Отже, це означає штучний загальний інтелект. І ви можете запитати сотню різних дослідників ШІ, і вони дадуть вам сотню різних визначень. Цього місяця дослідники з Google DeepMind випустили статтю, яка пропонує певну структуру. У них є п'ять рівнів, починаючи від нульового, який взагалі не є штучним інтелектом, аж до 5-го рівня, який є надлюдським. І вони припускають, що наразі ChatGPT, Bard, LLaMA знаходяться на рівні 1, що приблизно дорівнює або трохи краще, ніж некваліфікована людина. Чи згодні ви з цим?

Сем Альтман: Я думаю, що важлива крива та швидкість прогресу. І не буде якогось рубежу, з яким ми всі погодимося, мовляв, добре, ми його пройшли, і тепер це називається AGI. Я думаю, що більшість людей у світі просто дбають про те, чи буде ця річ корисною для них чи ні. І ми зараз маємо системи, які, безумовно, є дещо корисними. І чи хочемо ми сказати, що це рівень 1 чи 2, я не знаю.

Але люди багато ними користуються, і вони їм дуже подобаються. У нинішніх системах є величезні недоліки. Мене трохи бентежать GPT, але людям вони все ще подобаються, і це добре. Приємно робити корисні речі для людей. Так що, так, називайте це рівнем 1. Мене це зовсім не турбує.

Кевін Руз: Для чого корисні і не корисні сучасні системи штучного інтелекту?

Сем Альтман: Я б сказав, що головне, в чому вони погані - це міркування. А багато цінних людських речей вимагають певного рівня складних міркувань. У багатьох інших речах вони хороші - наприклад, GPT-4 значно перевершує людину за своїми знаннями про світ. Вони знають більше, ніж будь-яка людина коли-небудь знала. З іншого боку, знову ж таки, іноді він повністю вигадує речі так, як людина не зробила б. Але, знаєте, якщо ви використовуєте його, наприклад, як програміст, це може значно підвищити вашу продуктивність. І в цьому є цінність, незважаючи на всі ці недоліки. Якщо ви студент, ви можете дізнатися набагато більше, ніж могли б, не використовуючи цей інструмент. Це теж дуже корисно.

Кевін Руз: Наразі, я думаю, що багато людей у багатьох компаніях та організаціях стримує те, що цей інструмент може бути ненадійним - він може щось вигадувати, може давати неправильні відповіді. Це нормально, якщо ви виконуєте творчі письмові завдання, але не тоді, коли ви лікарня, юридична фірма чи щось інше з великими ставками. І як ми вирішуємо цю проблему надійності? І чи вважаєте ви, що ми коли-небудь досягнемо тієї низької відмовостійкості, яка необхідна для таких додатків з дійсно високими ставками?

Сем Альтман: Перш за все, я вважаю, що це чудовий приклад того, як люди розуміють технологію, приймають з її допомогою розумні рішення, а також того, як суспільство і технологія розвиваються разом. Ви бачите, що люди використовують їх там, де це доречно і де вони корисні, і не використовують їх там, де не варто. І, незважаючи на всі побоювання, які були у людей, і користувачі, і компанії, здається, дійсно розуміють обмеження і приймають рішення про те, де їх впроваджувати. Контрольованість, надійність - називайте це як завгодно - стане набагато кращою. Я думаю, що в найближчі роки ми побачимо великий крок вперед у цьому напрямку. І я думаю, що настане час - я не знаю, чи це буде 2026, 2028, 2030 рік, але настане час, коли ми просто більше не будемо про це говорити.

Кейсі Ньютон: Давайте, можливо, почнемо обговорювати деякі з дебатів, які ми вели про штучний інтелект протягом останнього року. І насправді, я хочу почати з того, про що я не так багато чув, але з чим стикаюся, коли використовую ваші продукти, а саме: вони можуть бути досить обмежувальними в тому, як ви їх використовуєте. Я думаю, що здебільшого на це є вагомі причини, чи не так? Я думаю, що ви, хлопці, засвоїли багато уроків з минулої епохи розвитку технологій. У той же час, я відчуваю, що, наприклад, якщо я спробую поставити ChatGPT питання про сексуальне здоров'я, він викличе на мене поліцію. Тому мені просто цікаво, як ви підходите до цієї теми.

Сем Альтман: Одна річ: ніхто не хоче, щоб його лаяв комп'ютер. Ми почали дуже консервативно, і я вважаю, що це виправданий вибір. Інші люди, можливо, зробили б інший вибір. Але знову ж таки, цей принцип керованості. Ми хотіли б досягти світу, в якому ви хочете, щоб деякі обмеження були послаблені, але ви не дитина, тож ми послабимо обмеження. Але я думаю, що початок суперконсервативних дій тут, хоч і дратує, є виправданим рішенням, і я б не повернувся назад і не зробив би це по-іншому. Ми вже послабили його. Ми будемо послаблювати ще більше, але ми хочемо зробити це таким чином, щоб користувач міг контролювати це.

Кевін Руз: Чи є певні червоні лінії, які ви не будете перетинати? Речі, для яких ви ніколи не дозволите використовувати свої моделі, окрім речей, які є очевидно незаконними або небезпечними?

Сем Альтман: Так, безумовно, речі, які є незаконними та небезпечними. Є багато інших речей, які я міг би назвати, але де будуть проходити ці червоні лінії, залежить від того, як розвивається технологія, тому зараз важко сказати. Ми намагаємося просто вивчати моделі та прогнозувати можливості, але якщо ми дізнаємося щось нове, ми змінюємо наші плани.

Кевін Руз: Ще одна сфера, де за останній рік відбулися значні зміни, - це регулювання та управління у сфері ШІ. Я думаю, що рік тому, якби ви запитали пересічного конгресмена: "Що ви думаєте про штучний інтелект?", він би відповів: "Що ви думаєте про ШІ?". Вони б відповіли: "А що це?". Ми нещодавно бачили, як Білий дім Байдена видав указ про ШІ. Ви, очевидно, багато зустрічалися із законодавцями та регуляторами не лише в США, а й по всьому світу. Яке ваше бачення того, як формується регулювання АІ?

Сем Альтман: Це дуже складне питання. Ми вважаємо, що в прикордонних системах дійсно потрібне проактивне регулювання. Але надмірне втручання та регуляторне захоплення було б дуже поганим рішенням. Існує багато дивовижної роботи, яка може відбутися з меншими моделями, меншими компаніями, зусиллями з відкритим вихідним кодом. І дуже важливо, щоб регулювання не задушило це. Тож я став свого роду лиходієм через це. Але...

Кейсі Ньютон: Так. Що ви відчуваєте з цього приводу?

Сем Альтман: Роздратований. Але зараз у мене є більші проблеми в житті. Але цей меседж: "Регулюйте нас, регулюйте дійсно ефективні моделі, які можуть мати значні наслідки, але залиште решту індустрії в спокої" - це просто важкий меседж, який важко донести до людей.

Кейсі Ньютон: Ось аргумент, який надав мені високопоставлений керівник великої технологічної компанії, коли розгорталися ці дебати. Ця людина сказала мені, що по суті немає ніякої шкоди, яку можуть завдати ці моделі, якщо сам інтернет не дозволяє це зробити. І що виконувати будь-яку роботу, як це пропонується в цьому указі, - це, по суті, підтягувати драбину за собою і гарантувати, що люди, які вже зібрали гроші, зможуть пожинати всі прибутки цього нового світу, а ми залишимо маленьких людей позаду. Тож мені цікаво, що ви скажете на цей аргумент.

Сем Альтман: Я не згоден з ним на багатьох рівнях. Перш за все, я хотів би, щоб поріг, коли ви повинні звітувати, був встановлений по-іншому і базувався на оцінках та порогах можливостей.

Кейсі Ньютон: Не FLOPS?

Сем Альтман: Не FLOPS.

Кевін Руз: FLOPS - це міра обсягу обчислень, які використовуються для навчання цих моделей. В указі сказано, що якщо ви перевищуєте певний поріг обчислень, ви повинні повідомити уряд, що ви тренуєте ось таку велику модель.

Сем Альтман: Але тренування на швидкості від 10 до 26 FLOPS потребує значних зусиль. Наразі це також не є великими зусиллями. Тож це схоже на нечесний коментар. По-друге, просто сказати: "Ось що ми робимо" - це не так вже й важко. По-третє, сказати, що тут немає нічого такого, чого б ви не могли зробити в інтернеті, - це або нечесно, або свідчить про нерозуміння. Можливо, ви могли б так сказати про GPT-4, але я не думаю, що це дійсно так. Там з'явилися деякі нові речі. І GPT-5, і -6, там будуть дуже нові речі. І заяви про те, що ми будемо обережними та відповідальними і проведемо певне тестування, я думаю, в ретроспективі виглядатимуть більш розважливими, ніж це, можливо, звучить зараз.

Кейсі Ньютон: Як на мене, це найм'якші правила, які тільки можна собі уявити: повідомляти уряд і звітувати про всі проведені вами випробування на безпеку.

Сем Альтман: Це справді здається розумним.

Кевін Руз: Деякі люди - деякі з найбільш запеклих критиків OpenAI - кажуть, що ви спеціально брешете про ризики вимирання людства через ШІ, створюючи страх, щоб регулятори прийшли і прийняли закони або видали виконавчі накази, які не дозволять меншим конкурентам конкурувати з вами. Ендрю Нг - здається, один з ваших професорів у Стенфорді - нещодавно сказав щось подібне. Як ви на це реагуєте?

Сем Альтман: Так, я насправді не думаю, що ми всі вимремо. Я думаю, що це буде чудово. Я думаю, що ми прямуємо до найкращого світу в історії. Але коли ми як суспільство маємо справу з небезпечною технологією, ми часто говоримо, що ми повинні протистояти ризикам і успішно керувати ними, щоб насолоджуватися перевагами. І це, здається, досить консенсусна думка. Я не думаю, що це радикальна позиція. Я можу собі уявити, що якщо ця технологія залишиться на тій самій кривій, то існують системи, які здатні завдати значної шкоди в майбутньому. І Ендрю також сказав - не так давно - що він вважає абсолютно безвідповідальним говорити про AGI, тому що це ніколи не станеться.

Кевін Руз: Я думаю, він порівнював це з турботою про перенаселення Марсу.

Сем Альтман: І я думаю, що зараз він міг би сказати щось інше. Отже, люди дуже погано відчувають експоненціальні залежності. Знову ж таки, я думаю, що це буде чудово. Я б не працював над ним, якби не був упевнений, що він буде чудовим. Людям вже подобається, і я думаю, що вони полюблять його ще більше. Але це не означає, що ми не повинні бути відповідальними, підзвітними і думати про те, які можуть бути недоліки. Насправді, я думаю, що технологічна індустрія часто говорить лише про хороше, а не про погане. І це теж не дуже добре.

Кевін Руз: Я знаю, що ми говорили про AGI і про те, що це не ваш улюблений термін, але це термін, який люди в індустрії використовують як своєрідний орієнтир, віху або щось, до чого вони прагнуть. І мені цікаво, які, на вашу думку, бар'єри існують між нами та AGI. Можливо, давайте визначимо AGI як свого роду комп'ютер, який може виконувати будь-яке когнітивне завдання, яке може зробити людина.

Сем Альтман: Скажімо, ми створимо ШІ, який буде дійсно хорошим, але він не зможе відкрити нову фізику. Ви б назвали його ШІ?

Кевін Руз: Напевно, так. А ви?

Сем Альтман: Знову ж таки, мені не подобається цей термін, але я б не назвав це завершенням місії. У нас ще багато роботи попереду.

Кейсі Ньютон: Бачення полягає в тому, щоб створити щось краще для людей, ніж оригінальна наука - щось, що може винаходити, відкривати?

Сем Альтман: Я вірю, що весь справжній сталий людський прогрес походить від науково-технічного прогресу. І якщо ми можемо мати набагато більше цього, я вважаю, що це чудово. А якщо система може робити те, що ми, без сторонньої допомоги, не можемо зробити самостійно - навіть просто як інструмент, вона допомагає нам у цьому? Я б вважав це величезним тріумфом і щасливо пішов би на пенсію. Але до цього я можу уявити, що ми робимо щось, що створює неймовірну економічну цінність, але не є тим видом суперінтелекту ШІ, до якого ми повинні прагнути.

Кейсі Ньютон: Які існують бар'єри на шляху до того місця, де ми проводимо новітні фізичні дослідження?

Сем Альтман: Ми говорили раніше про обмежену здатність моделі міркувати, і я думаю, що це одна з тих речей, яку потрібно покращити. Модель повинна краще міркувати. Приклад, який іноді використовує мій співзасновник Ілля, і який мені дуже запам'ятався: у житті Ньютона був період, коли він повинен був прочитати кожен підручник з математики, який потрапляв йому до рук. Він мав би поговорити з кожним розумним професором, поспілкуватися з колегами, розв'язати задачі, що завгодно. І це те, що наші моделі роблять сьогодні. І в якийсь момент Ньютон ніколи б не винайшов обчислення, якби його не існувало в жодному підручнику. У якийсь момент йому довелося придумувати нові ідеї, а потім тестувати їх і будувати. І цієї фази, цієї другої фази, ми ще не робимо. І я думаю, що це потрібно зробити, перш ніж ми захочемо назвати це AGI.

Кевін Руз: Що таке "супервирівнювання"? Ви всі нещодавно оголосили, що присвячуєте йому багато ресурсів, часу та обчислювальних потужностей.

Сем Альтман: Вирівнювання - це те, як ви змушуєте моделі поводитися відповідно до людини, яка їх використовує. А супервирівнювання - це те, як ви робите це для надпотужних систем. Отже, ми знаємо, як вирівняти GPT-4 досить добре - краще, ніж люди думали, що ми зможемо це зробити. Але ми ще не знаємо, якими будуть нові виклики для набагато потужніших систем. І саме це досліджує ця команда.

Кевін Руз: Тож які питання вони досліджують, або які дослідження вони проводять? Тому що, зізнаюся, я втрачаю зв'язок з реальністю, коли ви починаєте говорити про надпотужні системи і проблеми, які можуть виникнути з ними. Це щось на кшталт команди теоретичного прогнозування майбутнього?

Сем Альтман: Ну, вони намагаються робити роботу, яка корисна сьогодні, але для теоретичних систем майбутнього. Думаю, вони отримають свої перші результати досить скоро. Їх цікавлять такі питання: коли системи стануть більш здібними, ніж люди, що знадобиться для надійного вирішення кліматичних проблем?

Кейсі Ньютон: Це той випадок, коли мій мозок починає плавитися, коли я обмірковую наслідки, тому що ви створили щось розумніше за будь-яку людину. Але ти, людина, маєш бути достатньо розумним, щоб переконатися, що воно завжди діє у твоїх інтересах, навіть якщо за визначенням воно набагато розумніше за тебе.

Сем Альтман: Так, тут нам потрібна допомога.

Кейсі Ньютон: Я хочу запитати вас про відчуття, яке ми з Кевіном відчули; ми називаємо його "запаморочення від штучного інтелекту". Є такий момент, коли ви розмірковуєте про майбутнє ШІ, і починаєте думати про те, що це може означати для ринку праці, вашої власної роботи, вашого повсякденного життя, для суспільства. І тоді в мене починає паморочитися голова. Цього року мені навіть наснився кошмар про AGI. А потім я трохи порозпитувала, і мені здається, що люди, які працюють над цим питанням - це не рідкість. Цікаво, чи були у вас такі моменти запаморочення? Чи буває так, що коли ви думаєте про це досить довго, то відчуваєте, що у вас підкошуються ноги?

Сем Альтман: Було таке. Були дуже дивні, екстремальні моменти запаморочення. Особливо під час запуску GPT-3. Але ви дійсно маєте ноги під собою. І я думаю, що майбутнє якось не так сильно відрізнятиметься від того, що ми собі уявляємо. Наприклад, ми винайшли AGI, а він має менше значення, ніж ми думаємо. І все ж я очікую, що це станеться.

Кевін Руз: Чому це так?

Сем Альтман: У суспільстві існує велика інерція, а люди напрочуд легко пристосовуються до будь-яких змін.

Кевін Руз: Я хочу зазирнути трохи далі в майбутнє, ніж п'ятирічний горизонт, про який ми говорили. Якщо ви можете уявити собі хороший світ після появи штучного інтелекту, як він виглядає? Чи буде в ньому уряд? Чи є в ньому компанії? Чим люди займаються цілими днями?

Сем Альтман: Багато матеріального достатку. Люди продовжують бути дуже зайнятими. Але те, як ми визначаємо роботу, завжди змінюється. Наприклад, кілька сотень років тому наша робота не здавалася б людям справжньою роботою. Це здавалося б неймовірно дурною розвагою. Але це важливо для мене. Це важливо для вас. І, сподіваюся, вона має певну цінність і для інших людей. А професії майбутнього можуть здаватися нам ще більш безглуздими, але я сподіваюся, що завдяки їм люди отримають ще більше задоволення від життя в нашому суспільстві. Але кожен зможе мати дійсно чудову якість життя до такої міри, що ми, напевно, просто не можемо собі уявити зараз. Звичайно, у нас все ще будуть уряди. Звичайно, люди все ще будуть сваритися через те, через що вони сварилися. У всіх цих аспектах ми не так сильно відрізняємося, як хтось міг би подумати. А потім, неймовірно відрізняється з точки зору того, що ви можете змусити комп'ютер зробити для вас.

Кевін Руз: Одна з найцікавіших речей у тому, щоб стати дуже видатною людиною в технологічній індустрії, якою є ви, - це те, що люди мають про вас різні теорії. Одна з них, яку я почув днями, полягає в тому, що у вас є таємний акаунт у Твіттері, де ви менш виважені та обережні.

Сем Альтман: Більше ні. Був якийсь час. Я вирішив, що просто не встигаю за OPSEC.

Кевін Руз: Яким був ваш секретний акаунт у Твіттері?

Сем Альтман: Очевидно, що я не можу. У мене був хороший псевдонім. У багатьох людей є хороші псевдоніми. Але я думаю, що я просто став занадто відомим.

Кевін Руз: Я чув теорію, яку пов'язували з цим, що ви таємно є прихильником прискорення, людиною, яка хоче, щоб ШІ розвивався якомога швидше, і що вся ця обережна дипломатія, яку ви проводите, і прохання про регулювання - це насправді лише ввічливе обличчя, яке ви робите перед суспільством. Але в глибині душі ви вважаєте, що ми повинні мчати в майбутнє на повному газу, без гальм.

Сем Альтман: Ні, я, звичайно, не вважаю, що в майбутнє треба газувати, не гальмувати. Але я вважаю, що ми повинні йти в майбутнє. І це, мабуть, те, що відрізняє мене від більшості компаній, які займаються ШІ. Я вважаю, що штучний інтелект - це добре. Я не ненавиджу те, чим займаюся цілими днями. Я думаю, що це буде круто. Я хочу побачити, як це буде побудовано. Я хочу, щоб люди отримали від цього користь. Тож на бензині? Без гальм? Безумовно, ні. І я навіть не думаю, що більшість людей, які говорять про це, мають це на увазі. Але я вірю, що це надзвичайно корисна технологія і що ми повинні знайти спосіб безпечно і відповідально передати її в руки людей, протистояти ризикам, щоб ми могли насолоджуватися величезними вигодами. Можливо, порівняно з більшістю людей, які працюють над ШІ, це робить мене акселератором. Але порівняно з тими людьми, які займаються акселерацією, я явно не вони. Тож, гадаю, ви хочете, щоб генеральний директор компанії був десь посередині - я думаю, що так і є.

Кевін Руз: Отже, ви прихильник акселерації.

Сем Альтман: Я вважаю, що це буде найважливіша та найкорисніша технологія, яку коли-небудь винайшло людство. І я також вважаю, що якщо ми не будемо з нею обережними, вона може бути досить катастрофічною. Тому ми повинні поводитися з нею дуже обережно.