Школи входять у добу генеративного штучного інтелекту не як у модну забавку, а як у нову інфраструктуру навчання. Після хвилі заборон у 2022-му більші округи дозволили контрольоване використання чат-ботів. Питання вже не «чи», а «як» саме вписати інструменти у щоденну педагогіку.

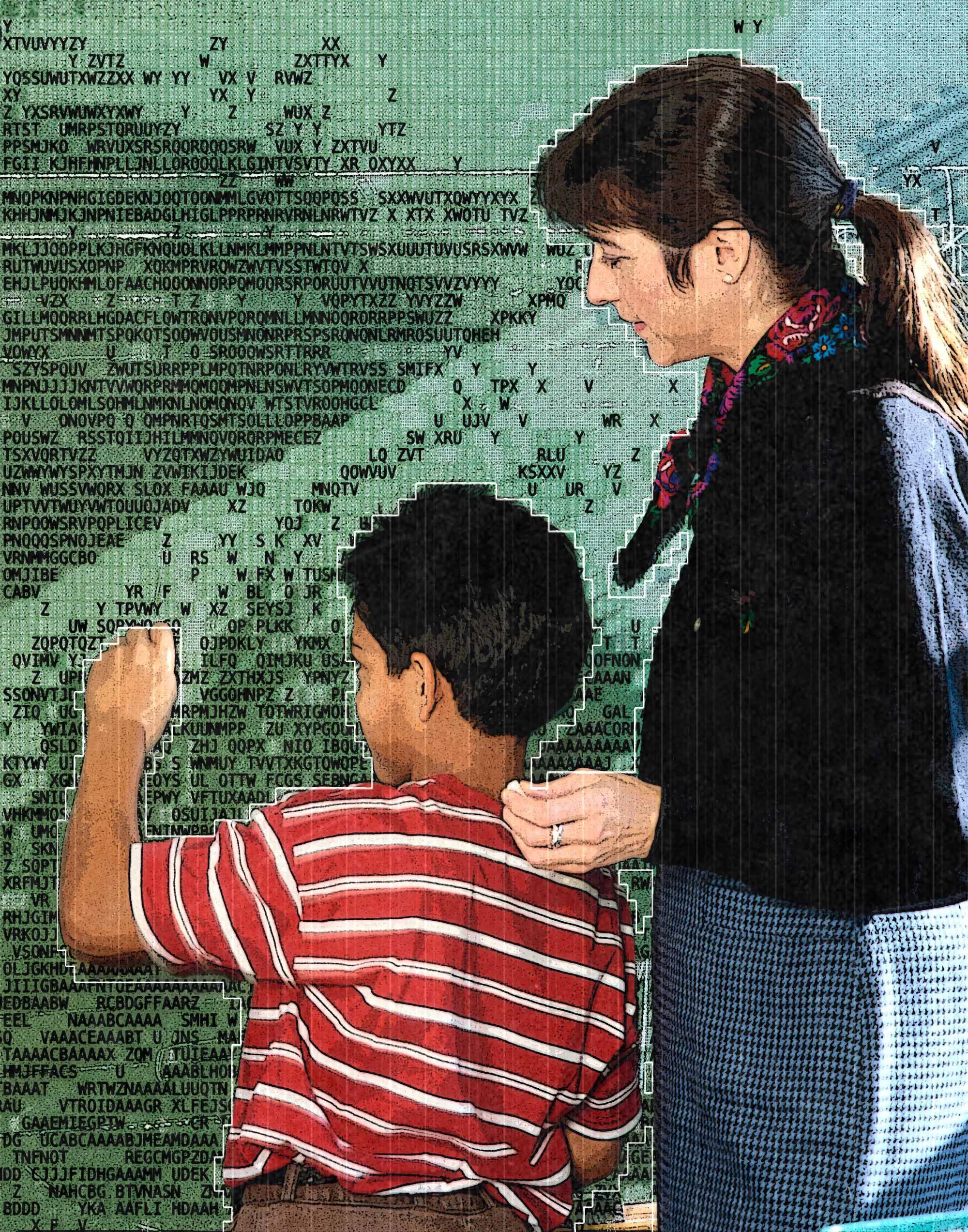

Перші експерименти показали практичний зиск: економію часу на рутини, оперативний чернетковий зворотний зв’язок і полегшення диференціації. Учитель менше переносить текст між шаблонами, більше працює віч-на-віч. Та жодна автоматизація не замінює методику і людський контакт.

Найяскравіше AI спрацьовує для персоналізації. Слабкі читачі отримують спрощені пояснення та поетапні підказки, сильні — додаткові питання й розширені джерела. Темп, формат і складність вправ підлаштовуються під учня, а вчитель спрямовує і коригує траєкторію навчання.

Втім, у генеративних моделей є вроджені ризики: фактичні помилки, вигадки і алгоритмічна упередженість. Тому культура сумніву та перевірки має стати звичкою уроку. Вимога наводити джерела, робити перехресну верифікацію й коротко усно захищати роботу стримує «автоген».

Академічна доброчесність потребує оновлення практик. Варто оцінювати не лише кінцевий текст, а й процес: чернетки, журнали змін, промпти й самооцінку рішень. Усні міні-захисти швидко відрізняють глибоке розуміння від механічної підстановки фраз, згенерованих моделлю.

Політика використання AI має бути публічною і зрозумілою для учнів та батьків. Вона окреслює дозволені сценарії, заборону повного «автопису», обов’язкове позначення допомоги інструментів і наслідки порушень. Чіткі правила знімають тривогу і підтримують довіру до школи.

Захист даних — перший фільтр відбору сервісів. Школа повинна вимагати мінімізації збору, короткого строку зберігання, прозорих журналів доступу й права на остаточне видалення. Агресивний моніторинг вебкамерою чи кейлогерами слід відкидати як надмірне втручання у приватність.

Ефективність залежить від підготовки вчителів більше, ніж від брендів платформ. Разові вебінари не працюють; потрібні хвилі навчання, коучинг у класі й спільноти практики. Вчитель, який розуміє межі інструмента, перетворює AI на асистента, а не на «чорну скриньку».

Пілотування корисно проводити в кількох курсах протягом 8–12 тижнів. До старту варто зафіксувати метрики: якість письма, мотивацію, частоту інцидентів. Після — оприлюднити звіт для громади. Така прозорість допомагає коригувати політику і зменшує міфи довкола технологій.

Якість завдань важить більше за новизну інструментів. Добре спроєктована робота змушує мислити, співставляти джерела і пояснювати вибір. Тоді AI доречний як довідник чи редактор. Слабкі завдання провокують поверховість і спокусу перекласти мислення на алгоритм.

Справедливість доступу лишається викликом. Школи з меншими ресурсами не повинні випадати з трансформації. Потрібні гранти на підготовку вчителів, базові пристрої та з’єднання, а також «білі списки» перевірених сервісів і шаблони політик, доступні кожній громаді.

Етика штучного інтелекту має вийти за межі попереджень. Учнів слід учити формулювати якісні запити, розпізнавати упередження і говорити про вплив інфраструктури даних на довкілля та демократію. Критичне мислення тут таке ж важливе, як і грамотність читання.

Рішення «від одного вендора» підвищує ризик залежності. Школа має забезпечити переносимість даних і сценарій виходу без втрат. У договорах варто фіксувати вимоги до аудиту безпеки, режим видалення записів і заборону вторинного використання учнівського контенту.

Використання аватарів історичних постатей доречне лише з перилами. Необхідні чіткі критерії тону, посилання на першоджерела і обмеження на теми, де спотворення контексту особливо шкідливе. Інакше учні приймуть стилізацію моделі за справжню думку автора.

Фінальний принцип простий: AI — сервіс, не суддя і не автор. У центрі освіти залишаються живий учитель, цікаве завдання і чесний процес. Якщо зберегти цю ієрархію, інструменти додадуть швидкості без втрати глибини, а школа збереже людяність, зміст і довіру.